4月24日,摩尔线程携手智源众智FlagOS社区,在旗舰级AI训推一体全功能GPU MTT S5000上,率先实现对新一代大模型DeepSeek-V4-Flash的Day-0极速适配,并完成了全量核心算子的深度优化与部署支持。

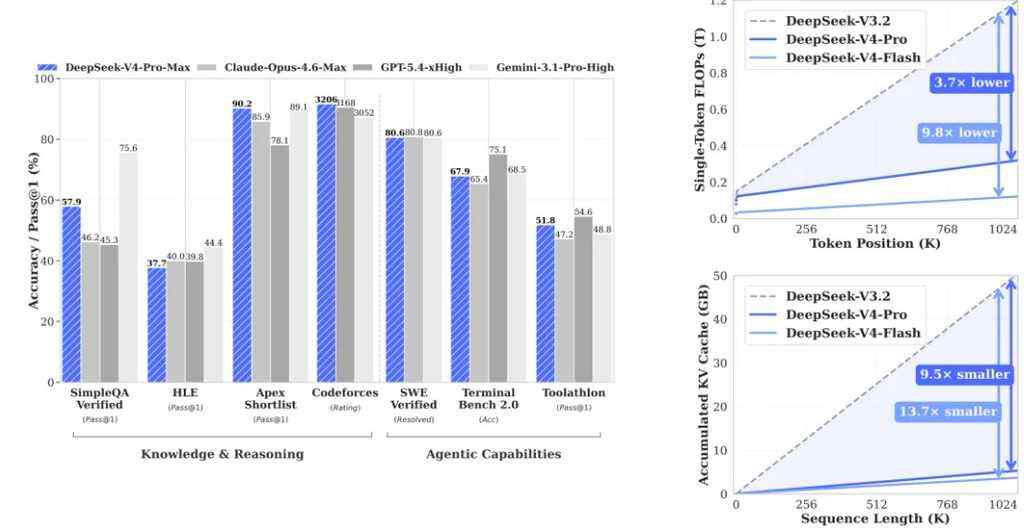

DeepSeek-V4-Flash 采用混合专家(MoE)架构,总参数量高达284B,激活参数13B,支持百万token上下文长度。其预训练数据超32Ttoken,在最大推理力度模式(Flash-Max)下推理能力逼近Pro版本。值得关注的是,V4模型首次采用“FP4+FP8”混合精度策略,而当前国内主流 AI 芯片仍普遍以BF16为主。而摩尔线程凭借独特的原生FP8支持优势,能够更高效承载 DeepSeek-V4 的前沿精度设计,为模型部署与推理优化提供了坚实的算力底座。

作为国内率先原生支持FP8精度的全功能GPU,MTT S5000配置了强大的硬件级FP8 Tensor Core 加速单元。相比传统的BF16/FP16,FP8能够将数据位宽直接减半,使显存带宽压力降低 50%,理论计算吞吐量实现翻倍。

为充分发挥MTT S5000在FP8计算上的内核优势,FlagOS对DeepSeek V4模型进行了FP8量化。通过系统级分析,双方技术团队将本次适配的攻坚重点锁定在FP8算子与Sparse Attention算子。针对这两个决定长上下文效率与极致推理性能的关键算子,团队从“编译优化”与“自动调优”两个核心方向取得了重大突破:

▼ 方向一:深入利用摩尔线程 FlagTree编译器能力,提升底层执行效率。通过精细化的 shape 对齐策略,使 FP8 和 Sparse Attention 的计算 shape 更好地满足摩尔线程张量访存与计算引擎(TME/TCE)的要求;同时结合 MUSA_ENABLE_SQMMA,进一步加速 tl.dot 矩阵计算。

▼ 方向二:借助 FlagOS-Tune,自动搜索最优 Triton 内核配置。FlagOS-Tune 能够扩展算子的搜索空间,基于模型真实 shape 离线搜索 FP8 和 Sparse Attention 算子的最优内核配置,效果优于手工调参。

在离线优化之外,FlagOS-Tune还支持在线内核配置搜索能力。用户只需开启环境变量 USE_FLAGTUNE=1,经过一段时间的 warmup 后,系统基于实际运行过程持续搜索并应用最佳配置。其中,TTFT 时延降低 16.5%,ITL 时延降低 39.7%,Throughput 提升 65.7%。

当前,摩尔线程与FlagOS社区正持续推进拥有1.6T旗舰模型(1.86万亿参数)的DeepSeek-V4-Pro在MTT S5000上的迁移适配工作。未来,摩尔线程将继续以MUSA架构与全功能GPU的全栈技术优势,为国产大模型生态提供更高效、更自主可控的算力基石。

开发者可下载镜像进行开箱体验:

DeepSeek-V4-Flash

▼魔塔平台:https://modelscope.cn/models/FlagRelease/DeepSeek-V4-Flash-mthreads-FlagOS

▼ HuggingFace 平台:https://huggingface.co/FlagRelease/DeepSeek-V4-Flash-mthreads-FlagOS

- 斯坦福评测第一!北大 EvoPhys-World世界模型在摩尔线程GPU完成原生训练 – 2026年6月8日

- 步入关键行业深水区,中国电子云亮出“专属AI云”底牌 – 2026年6月8日

- 东软智行与高通技术公司推动智能汽车系统未来发展 – 2026年6月5日